Le sujet de la modération à plusieurs vitesses du réseau social Facebook revient depuis des années, sans évolution positive de la part du réseau social; plus récemment Instagram est devenu aussi la cible de critiques semblables. Je suis utilisatrice des deux réseaux, à la fois en tant que queer féministe et en tant qu’artiste visuelle, et donc habituée du traitement problématique que Facebook et Instagram impose aux contenus que nous lui fournissons.

En rejoignant ces deux réseaux dans leur politiques réactionnaires, Tumblr, réputé beaucoup plus libre, a surpris tout le monde.

Il y aurait aussi beaucoup à dire sur Youtube, sa maison-mère Google, Twitter, etc – mais cet article ne prétend pas à l’exhaustivité et s’attarde en particulier sur les premiers réseaux cités.

Facebook, la censure à 42 vitesses

Facebook a une politique très stricte, voire réactionnaire, en matière de contenus images et textes. Je voudrais évoquer en particulier ses politiques concernant les représentations/visibilités du/des corps – des politiques qui visent avant tout les images, mais qui se sont renforcées en octobre 2015 en s’étendant au vocabulaire.

Pas de tétons mais des décapitations

C’est en ce qui concerne les images que la censure de Facebook est la plus virulente et constante. En théorie, la nudité est autorisée sous de rares exceptions: dans le “cadre d’une protestation, pour sensibiliser à une cause, ou à des fins pédagogiques ou sanitaires”. Sont également autorisées “les photos de peintures, sculptures et autres œuvres d’art illustrant des personnages nus” Reste à savoir ce qui relève pour Facebook (ses algorithmes comme ses petites mains), de nudité, de fins pédagogiques, d’art, etc. Quand on se penche sur les contenus censurés, on nage entre la pruderie, la misogynie et l’absurde, tant bien des cas de censure ne respectent eux-même aucunement ces “standards” déjà très stricts – j’en détaillerai ici quelques cas emblématiques :

C’est LE point qui revient le plus souvent dans les critiques émises à l’encontre des politiques Facebook, tant il est évidemment sexiste : la censure des tétons dits / perçus comme “féminins” (portés donc sur des seins, par opposition à torse plat, plus ou moins indépendamment du genre de la personne d’ailleurs). Facebook lutte contre la pornographie sur son réseau, et les tétons féminins sont donc assignés par défaut à une connotation strictement et en tout contexte, sexuelle – contrairement aux tétons masculins, qui ont le luxe de pouvoir être perçus comme un organe lambda du corps humain. Notons aussi que malgré les exceptions théoriques évoquées plus haut, des comptes présentant par exemple du travail de tatouage cosmétique ou artistiques sur des poitrines ayant survécu à des cancers sont censurés, depuis longtemps et jusqu’à encore très récemment.

Ici, le mystère reste entier: absurdité des algorithmes qui confondent bourrelets et nichons ? signalements grossophobes massifs ? salarié Facebook très zélé ? Il y a en tout cas eu plusieurs cas de censure de photos et vidéos de personnes grosses, certes en partie dénudées mais sans que théoriquement cela ne contreviennent aux “standards de la communauté” : ni tétons, ni sexe, ni même fesses. Des militantes visibilisaient ce phénomène l’année dernière, lorsqu’une vidéo de trois activistes du groupe Gras Politique en train de danser de dos sans t-shirt étaient censurée par Facebook.

Une autre censure qui fait régulièrement le buzz, c’est celles d’œuvres d’art : citons tout récemment une vidéo de l’Opéra de Bavière avec des amazones torse nu, une statue de Neptune il y a quelques mois ou bien sûr le tableau de Courbet l’Origine du monde, censuré en 2011…

Des images censurées par Facebook suivies de suspension de compte, en contradiction flagrante aux les règles édictées par Facebook itself. Et si à titre personnel la distinction pornographie / art me semble à interroger, le fait que Facebook assimile un opéra à de la pornographie n’a évidemment rien à voir avec la volonté de déconstruire des catégories rigides, c’est par contre symptomatique de ses politiques tellement réactionnaires et/ou absurdes qu’elles en deviennent risibles.

Dans chacun de ces cas, les images incriminées sautent et le compte est suspendu pour une durée variable (dépendant du nombre d’ “infractions” déjà commises par le compte concerné).

Et l’on atteint des sommets de ridicule lorsque des photos de paysage, par exemple de dunes de sable, sont automatiquement censurées car interprétés par les algorithmes comme des corps nus.

Inversement (moment pro-tips), il est facile d’empêcher l’analyse d’un téton par les algorithmes à l’aide d’une légère perturbation de l’image (comme un trait sur le téton). Cela n’empêche cependant pas les censures suite à des vérifications manuelles de la part de Facebook.

Facebook censure les tétons femelles depuis ses débuts, mais Facebook, en 2013, se retrouvait ciblé par des associations féministes pour n’avoir pas censuré des vidéos de viol. Toujours en 2013, Facebook répondait (via une agence de de relations publiques allemande), face au tollé que provoquait la mise en ligne de la vidéo de la décapitation d’une femme, que “[sa] décision de ne pas supprimer cette vidéo est basée sur le fait que les gens ont le droit de décrire le monde dans lequel nous vivons, de présenter et de commenter les actions”. Après quelques journées de pression, la vidéo a finalement été supprimée.

C’était en 2013 me diras-tu, et depuis, Facebook a changé ses standards et amélioré ses algorithmes, certes – mais je doute que cela suffise. En réalité, peu après la suppression de la vidéo susmentionnée, le réseau autorisait discrètement à nouveau les vidéos de décapitation, pourvu qu’elles soient accompagnées d’un message qui condamne ladite décapitation. Plus récemment (mars 2017), en ouvrant mon fil d’actualité je tombais sur la vidéo du meurtre de Dandara dos Santos, femme transgenre assassinée et dont la mise à mort a été filmée par ses meurtriers. Facebook censure toujours bien plus rapidement et efficacement les tétons de femmes que d’atroces crimes violents.

Si l’on considère que montrer des meurtres, c’est “décrire le monde dans lequel nous vivons”, Facebook permets-moi de te rappeler que le monde dans lequel nous vivons comporte aussi… des tétons de femmes.

“Appels à la haine” et “sollicitations sexuelles”

Si la censure concerne donc en grande partie les images postées sur le réseau social, elle s’applique également de plus en plus au texte.

Cela fait longtemps qu’au nom de la lutte contre la haine en ligne, Facebook censure tout post comportant des “injures”, y compris lorsqu’elles sont utilisés par les personnes concernées – et c’est bien là que ça pose problème. Usant du retournement d’insultes propre aux luttes des nombreux groupes discriminés, une grande partie de la communauté queer emploie par exemple bien plus volontiers les mots “gouines” et “pédés” pour se désigner plutôt qu’”homosexuel.les”. Là encore, en théorie, Facebook indique que “certains mots ou termes qui pourraient enfreindre nos règles sont utilisés de manière autoréférentielle ou de manière valorisante. Dans ce cas, nous autorisons le contenu, mais attendons de ces utilisateurs qu’ils indiquent clairement leur intention afin de nous aider à mieux comprendre pourquoi ils le partagent.”

Dans la réalité, sur une page Facebook, tout post comportant un tel mot utilisé dans une optique positive et d’empowerment a toutes les chances d’être détecté et supprimé – j’en ai fait les frais, en parlant de gouines. Sans doute n’indiquais-je pas assez “clairement mon intention”: le flou qui entoure une telle injonction laisse évidemment à Facebook toute latitude d’appliquer sa censure sans vraiment de recours.

Plus largement, il est intéressant de se pencher sur les différentes “attaques” qui constituent des appels à la haine pour Facebook, dès qu’on dépasse les premières lignes qui énumèrent bien entendu les attaques en raison du sexe, du handicap ou de l’origine nationale ; au-delà de ce premier paragraphe, tout se complique.

On notera par exemple, que la “référence ou comparaison” à des “prédateurs sexuels” constitue une attaque et donc un appel à la haine; en clair, un post qui qualifierait tel homme célèbre du milieu du cinéma de prédateur sexuel est susceptible de constituer une infraction aux standards Facebook. Clairement, Facebook se prémunit contre la diffamation. Il est également prohibé de comparer une personne… à “un insecte”. Soit.

Enfin, en théorie Facebook autorise les commentaires “sociaux” et “humoristiques”, sans aucun développement du sens et des cas de figures précis que recouvrent ces deux termes ; cette exception permet, peut-on imaginer, de ne pas toucher à nombre de commentaires sexistes ou racistes postés au nom de l’humour, ni à des images “comiques” de violence conjugale. Inversement, il semble que l’humour misandre, certes acerbe, souvent mobilisé par le féminisme actuel, ne soit pas perçu comme tel. Il semble que les messages misogynes soient plus tolérables (au nom de l’humour ?) que leurs réponses féministes. Ainsi il y a quelques mois, une page Facebook partageait un compte Instagram consacré aux messages non sollicités envoyés par des inconnus à des femmes; rapidement ce post a suscité des commentaires misogynes tels que “Feminists should be burnt on a bonfire” ; en réaction, le post a été intitulé “This Instagram account proves that all men are trash” ; résultat : le post a été censuré et le compte suspendu 24h. Chez Facebook, on pense donc que «les hommes sont des ordures» est plus offensant que «les féministes devraient être brûlées sur un feu de joie». Et si ça n’est pas ce qu’on pense, c’est en tous cas ce qui se produit – je reviendrai un peu plus loin sur la façon dont concrètement cette censure est réalisée.

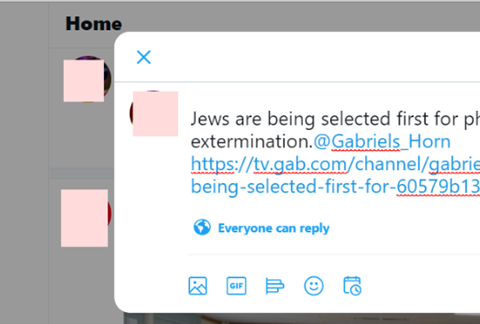

Le site Facebook Jailed fondé par une utilisatrice régulièrement bannie de Facebook, dénonce ce double standard, en partageant des publications censurées par Facebook tels que “Men are ugly”, en regard de publications misogynes, telles que “Women are scum”, considérées par Fb comme ne contrevenant pas à ses standards malgré les signalements. Même lorsque les phrases sont identiques, Facebook garde l’attaque contre les femmes et censure celle contre les hommes, comme l’exemple “Men are pigs” vs “Women are pigs” posté sur Facebook Jailed le montre. Pas touche aux hommes !

Récemment, j’ai vu tourner sur Facebook les photos d’un bus circulant à Madrid, affublé d’un grand message masculiniste, s’opposant à l’analyse des violences conjugales comme violences sexistes ; concrètement, la carrosserie du bus était recouverte de la phrase Ce n’est pas de la violence de genre, c’est de la violence domestique, du hashtag #StopFeminazis, et d’une photo de Hitler travesti d’un rouge à lèvre et de fard à paupière. Cette communication tout à la fois profondément misogyne et antisémite était donc réalisée et postée sur Facebook par le groupe Hazte Oír (Fais-Toi Entendre), membre de CitizenGo (déjà responsable d‘une campagne contre “la théorie du genre” en 2017). En tombant sur ces images, j’ouvrai à nouveau la page relative aux contenus interdits et en particulier en ce qui concerne les discours de haine, et lu que Facebook interdisait, toujours en principe et toujours dans sa section consacrée aux “discours de haine”, toute comparaison d’une personne ou d’un groupe humain à des “criminels violents” ; en vertu de cette règle, je signalai alors avec quelques camarades plusieurs photos de la page Facebook de Hazte Oír. Comparer les féministes à Hitler et aux nazis correspond très exactement à “comparer un groupe de personnes à des criminels violents” ; mais dans les faits, tous nos signalements ont abouti à la même réponse : les publications signalées ne contreviennent pas aux standards.

Facebook discrimine clairement les discours féministes, en particulier lorsqu’ils sont l’expression brute d’un ras-le-bol de la masculinité toxique et du sexisme généralisé, sous forme de punchlines définitives et d’humour misandre. Inversement, les contenus masculinistes sont rarement censurés, et nous sommes nombreuses à régulièrement signaler des publications et pages transphobes, misogynes, homophobes, en vain.

Tout récemment on a constaté en France (février 2019) une petite vague de censure de posts et de liens vers des contenus textuels en lien avec les transidentités et/ou les luttes trans, sans explication de la part de Facebook. Difficile de savoir ce qui contrevenait précisément aux règles. Est-ce que tout post évoquant des questions de sexualité ou de genre relève potentiellement pour Facebook de la “pornographie” ou du contenu explicite ? Ou encore, ces posts ont-ils assimilés à des “appels à la haine” ? – puisqu’en effet, comme pour le cas du “men are trash”, des posts à caractère féministe et/ou transféministes et porteurs de critiques plus ou moins acerbes ou ironiques envers les hommes ou les personnes cis, sont censurés. Ou, encore plus simplement, le mot trans, comme les mots gay ou lesbienne, a-t-il été analysé par un algorithme ou un·e travailleur·se Facebook comme pornographique ? Rappelons-nous qu’en 2017, Youtube de son côté passait en mode restreint de très nombreuses vidéos LGBT, considérant que les mots gay, lesbienne, trans / transgenre / transexuel.le suffisaient à constituer un contenu adulte (porno, donc) – lire à ce propos cet article

Notons aussi, même si cet autre aspect de la modération à deux vitesses de Facebook mériterait un article à lui tout seul, un grand laxisme face aux contenus fascisants, qu’ils soient (comme on l’a vu) masculinistes, ou racistes, anti-migrants, antisémites, xénophobes, conspirationnistes… Facebook ne veut pas de cul sur sa plateforme, mais ne s’inquiète pas vraiment du reste, bien au contraire.

Récemment, le Los Angeles Times montrait que le réseau traitait le nazisme comme un centre d’intérêt comme un autre, en tous cas dans sa gestion des publicités

La publicité sur Facebook consiste à “booster” une publication, c’est-dire payer pour rendre cette publication visible pour plus de monde. Il est possible de cibler son public, ou “audience”, en fonction de “centres d’intérêts” au moment où l’on paramètre sa publicité. Si Facebook a banni “Adolf Hitler” des “centres d’intérêt” que l’on peut cibler, l’effort reste bien trop léger puisqu’il est tout à fait possible de cibler une audience ayant notifié son intérêt pour “Himmler” et “Mengele”, comme l’expliquait le LA Times, qui exposait que plus d’un million de profils Facebook avait par exemple manifesté leur intérêt pour “Joseph Goebbels”. Oserait-on supposer que Facebook ne souhaite pas perdre un tel nombre d’utilisateurs en luttant réellement contre les contenus d’extrême-droite ?

Dans la même veine, Facebook n’a sans doute pas d’intérêt à réellement combattre les fake news, le négationnisme ou le conspirationnisme, qui sont des courants de pensée sans doute à la fois plus partagés et générateurs d’interactions que le féminisme. Au nom de la liberté d’expression, d’offrir « une voix pour que les gens puissent exprimer leurs opinions », Mark Zuckerberg a ainsi été très clair sur le fait qu’il ne bannira pas les propos négationnistes, ou les fake news et autres théories complotistes –

Concluons ce panorama des contenus censurés – ou non – en revenant au cul, tant honnis par Facebook. Si jusqu’à présent, en matière de texte, la censure Facebook s’appliquait donc généralement au nom de la lutte contre les “appels à la haine”, depuis le 15 octobre 2018, les choses sont très claires : Facebook bannit désormais tout ce qui «facilite, encourage ou coordonne les rencontres sexuelles entre adultes», comme sa nouvelle section intitulée “Sollicitations sexuelles” l’indique. Cela concerne notamment les déclarations «implicites» du type «à la recherche d’un bon moment ce soir», des propos relevant de «l’argot sexuel», «la mention de rôles sexuels, de positions, de scénarios fétichistes» ou encore «la préférence du partenaire sexuel». Autant dire tout de suite que cela limite drastiquement à peu près tous les échanges qui concernent la sexualité, qu’il s’agisse de conseils, de dating, d’échanges spécifiques à des cultures sexuelles telles que le bdsm, d’éducation, etc, que cela affecte plus particulièrement les communautés LGBT et les travailleuse·rs du sexe, pour qui internet est un outil privilégié d’échange, de rencontre et d’auto-support.

Ce changement, s’il reste de toutes façons dans la lignée réactionnaire du site, pourrait aussi être dû à des circonstances extérieures. En avril 2018, Trump signait le projet de loi Fight Online Sex Trafficking Act (FOSTA) et Stop Enabling Sex Traffickers Act (SESTA). Cette loi a pour objectif affiché de lutter contre la prostitution sur internet, en rendant les plateformes et hôtes comme Facebook, Twitter, Craigslist, responsables du contenu publié. Cette loi donne le pouvoir de poursuivre et fermer tout espace sur le web américain qui est utilisé pour le commerce sexuel, y compris sans coercition, englobant (à l’image des lois contre le “proxénétisme” en France) le fait de “promouvoir, soutenir ou faciliter la prostitution d’une autre personne” – ce qui inclut donc tout autant la promotion explicite de services sexuels tarifés que l’échange de conseils entre travailleuses du sexe. Cette focalisation sur la lutte contre la prostitution – y compris consensuelle / sans exploitation – se fait en réalité surtout aux dépens des travailleur·ses du sexe elleux-mêmes.

En limitant leurs possibilités d’échanges d’informations, de black-listing de clients dangereux, d’entraide, mais aussi tout simplement de promotion de leurs activités de façon beaucoup plus sécurisée que dans la rue, cette loi précarise dangereusement les travailleuse·rs du sexe américain·es. Facebook est une ressources parmi d’autre pour les TdS (promotion de ses activités, groupes secrets de TdS) et le risque de suspension de son profil ou de suppression de groupes d’auto-support est d’autant plus dommageable dans un contexte où de nombreux autres sites ont purement et simplement fermé les sections tombant sous le coup de la loi SESTA/FOSTA (comme Craiglist). Pour en savoir plus sur les conséquences concrètes de ces lois sur la sécurité des travailleuse·rs du sexe, lire ici.

Cette loi est américaine, mais afin que les images et les contenus puissent être visibles par tou·tes sur facebook indépendamment du pays où chacun·e réside, il semble logique de niveler l’ensemble du réseau par le bas et donc de modifier les conditions d’utilisation sur l’ensemble de la plateforme, en harmonie avec les lois américaines décrites ci-dessus – et encore une fois, dans la lignée des politiques déjà rétrogrades de Facebook. Le rôle exact joué par la loi SESTA/FOSTA dans cette nouvelle règle n’est qu’une supposition, Facebook n’ayant pas communiqué explicitement dessus.

Enfin, notons qu’à mi-chemin entre le texte et l’image, les emojis occupent une place que Facebook ne laisse pas au hasard. Le site a ainsi récemment édité un guide d’utilisation des emojis, et y associe explicitement les emojis couronne, dollar, bouche maquillée, ou piétonne… à des “sollicitations sexuelles”.

Facebook, futur censeur du web ?

Facebook a de bien opaques et absurdes façons de lutter contre les discours haineux et discriminants, et de très conservateurs points de vue sur ce qui relève ou non de la pornographie. Pourtant, Facebook s’apprête à se voir confier des responsabilités énormes dans la lutte d’une part “contre le terrorisme”, d’autre part “contre la haine en ligne”, comme s’il s’agissait d’un héros de la modération:

En septembre 2018 la Commission Européenne proposait un règlement « relatif à la prévention de la diffusion en ligne de contenus à caractère terroriste », règlement qui délèguerait en grande partie à Facebook le blocage de contenus “terroristes”

À l’échelle française, récemment Marlène Schiappa et Mounir Mahjoubi présentait un « plan d’action contre les contenus haineux en ligne », texte qui encense Facebook et propose de lui déléguer une grande partie de ladite lutte.

L’analyse de ces deux propositions reste assez technique et n’est pas le sujet de cet article, je renvoie à deux articles de la Quadrature du Net celleux qu’intéressent les écueils et et dangers de cette double délégation à Facebook et aux GAFAM en général de la lutte “contre le terrorisme” et “contre la haine”

Instagram sur les pas de la maison-mère

Instagram est la propriété de Facebook depuis 2012 et impose de semblables conditions d’utilisation. Le réseau est une plateforme de partage d’images et son contenu est donc sensiblement différent de Facebook, il est beaucoup moins un lieu de débat et de polémiques, et moins concerné par l’envahissement de propos masculinistes, fascistes, racistes. Par contre, il est un lieu privilégié de partage d’images : Instagram est utilisé en grande partie par des artistes et des modèles, et est considéré comme une plateforme de visibilité indispensable par les professionnels de l’image et des arts visuels. La censure des tétons dits “féminins” y sévit comme sur Facebook. Comme sur Facebook, il est interdit de publier des œuvres d’art, qu’elles soient «dessinées à la main, numériques ou réelles» représentant une activité sexuelle explicite – dans les faits, les productions dessinées, sur Facebook comme sur Instagram, survivent plus facilement que les photos au passage impromptu des algorithmes sur la page, mais il est globalement très difficile pour les modèles et artistes travaillant le nu d’échapper aux mailles du filet de la censure. Les artistes féministes qui travaillent sur le corps voient leur visibilité entravée par rapport à d’autres types de production, comme l’a récemment dénoncé la photographe et modèle Romy Alizée, qui a vu son compte suspendu pour une photo incluant non pas de la nudité, mais un godemichet, assimilé par Instagram à une représentation d’activité sexuelle.

Les travailleuses du sexe, notamment les strip-teaseuses, nombreuses également à proposer leurs services via Instagram, ont du nettoyer leurs comptes depuis que la loi SESTA/FOSTA a amené Instagram à censurer divers hashtags, tels que #strip-teaseuse, #yesastriper, #femalestriper, voire temporairement les posts les plus populaires du hashtag #women…

En parallèle, Playboy et son compte empli de photos plus explicites les unes que les autres ne rencontre pas de problème. À partir du moment où la règle minimale de ne pas montrer de tétons ni de parties génitales est bien respectée, les paires de fesses et les poses lascives des comptes connus ne semblent jamais tomber sous le coup d’une censure zélée. J’ai épluché le compte Instragram de Playboy, qui flirte constamment avec les limites des régles de Instagram et Facebook : des seins en gros plan aux tétons cachés d’une main, une vulve-orchidée, une vulve à peine masquée par une fermeture éclair, un coït avec pénétration hors-champ, et beaucoup de paires de fesses dénudées (pourtant, à l’instar des génitaux, Instagram et Facebook bannisent “des plans rapprochés de fesses entièrement exposées”). Mais, pour Playboy, la modération n’abuse pas. Difficile de trouver des sources qui expliquent ce traitement différencié, et de savoir jusqu’à quel point le poids économique, la notoriété, et la conformité aux standards hétéromasculins, jouent en la faveur de Playboy.

Mais quoi qu’il en soit, Instagram, comme Facebook, ne lutte pas contre la réification ou la sexualisation des femmes, contre le sexisme et l’exploitation, mais seulement contre l’idée que le puritanisme se fait de la pornographie. Et pour le moment, les fesses en string et les bouches pulpeuses entrouvertes ne sont pas bannies, surtout chez les gros comptes ; mais si Playboy, géant capitaliste, parvient encore à garder sa place au chaud sur les réseaux sociaux, sans doute chez eux aussi sent-on venir le vent conservateur ; ainsi ironiquement, c’est Playboy qui relaie la parole des stripeuses pénalisées par la loi FOSTA/SESTA et les nouvelles règles des réseaux sociaux.

A propos de travail, de travailleur·ses, et de monopole

Ces plateformes n’indiquent jamais si la censure survient suite à une manipulation humaine ou à une détection algorithmique. J’insiste sur cette opacité: comment savoir ce qui relève de la censure humaine et de la censure automatiquement générée par des intelligences artificielles ? Quelles consignes sont données aux petites mains de Facebook ou Instagram qui effectuent ces censures ? Existe-t-il des formations en interne, ou les salarié·es sont-iells laissé·es libres d’interpréter les règles édictées, voire encouragé·es à les distordre autant que possible vers la droite ? Ces personnes ont à charge de modérer le plus gros réseau social du monde, et j’étais curieuse de savoir si le degré de misogynie, d’homophobie, de racisme des candidat·es était évalué et entrait en compte dans le recrutement, s’il était encouragé, nié, ou si la question ne se posait même pas. Je me suis posé la question du degré d’intentionnalité derrière chacune de ces censures, ou, a contrario, de laxisme envers des propos discriminants (misogyne, homophobe, etc). Je me suis demandé qui était en charge d’effectuer cet ingrat travail de sélection et censure: Mark Zuckerberg n’est sans doute pas en personne derrière son écran à modérer en ricanant chacun de nos milliards de posts.

Lou, de la Quadrature du Net, m’a apporté quelques éléments de réponse. Si Facebook, comme tous les géants du web, communique sur et met en avant ses “intelligences artificielles”, ses robots, ses algorithmes, cela masque une une autre réalité, qui est que cet ingrat travail de modération et largement effectué par celleux que Antonio Casilli (auteur de En attendant les robots, Enquête sur le travail du clic – Seuil) appelle des “travailleurs du clic”. Les algorithmes ne peuvent pas suffire. Les intelligences artificielles développées par Facebook scannent les contenus, et si le robot tombe sur ta page et sur ton post contenant tel ou tel mot “injurieux”, le couperet a des chances de tomber automatiquement. Aveugle, le robot scanne les mots et les photos, et parfois, souvent, détecte un bourrelet qu’il prend pour un sein, un mot insultant sans comprendre le contexte textuel, et censure le contenu analysé comme contrevenant aux standards. Parfois cependant, le robot ne fait qu’un premier tri, car il n’est pas sûr, et c’est à un·e “travailleur du clic” de prendre une décision finale.

Parfois, les posts et les images sont directement analysées par ces travailleur·ses – il n’y a pas vraiment de moyen de savoir précisément comment se répartissent les tâches entre les IA et les humains, combien sont ces humains, ni d’où iells travaillent. Mais ce qui est sûr, c’est que de très nombreux·ses travailleur·ses sont exploité·es, parfois de chez elleux, parfois dans des “fermes à clic”, localisées aux Etats-Unis mais aussi en Inde et Asie du Sud-Est. Ces travailleur·ses sous-payé·es (ici pour avoir une idée de leurs conditions de travail ) sont chargé·es d’appliquer les règles édictées par Facebook en matière de contenu et de compléter et soutenir le travail effectué par les IA.

Mais comment, en l’absence de formation, de contexte culturel adéquat, de maîtrise des dizaines de langues utilisées sur Facebook, pourrait-on attendre de ces travailleur·ses qu’iells fassent ce que nous considérons comme les bons choix ? Si par exemple, la réappropriation de l’insulte queer, dans un contexte américain, est un fait culturel de plus en plus répandu et donc de plus en plus (re)connu (par les clickworkers comme par les IA), les posts qui contiennent ce mot sont de moins en moins censurés ; mais lorsque comme récemment, Tal Bruttmann s’auto-qualifie de youpin, il y a fort à parier que le fait culturel de la réappropriation de ce mot dans un contexte français soit bien trop anecdotique pour être (re)connu, et le post avait toutes les chances d’être censuré – ce qui fut fait.

De même, que sait-on des connaissances de ces travailleur·ses en matière d’histoire de l’Art occidentale ? Si la·e “travailleur du clic” tombé·e sur l’Origine de Monde en 2011 ne connaissait tout simplement pas ce tableau et son importance dans l’histoire française de la peinture, c’est peu étonnant que cette image soit tombée sous le coup de la censure. Quant aux images et propos assimilant les féministes à Hitler et aux Nazis, que sait exactement un travailleur indien des crimes commis par Hitler ? l’a-t-il même reconnu sous le maquillage féminin dont l’ont affublé les auteurs de cette campagne ? Quand les activistes queer et trans signalent des pages pour propos transphobes, qu’attendre d’un réseau qui semble considérer avant tout que “transexuelle” est un mot pornographique ? En confiant le travail de modération à des travailleur·ses pauvres, exploité·es, ni formé·es ni informé·es, il est impossible pour Facebook d’exercer une gestion intelligente, renseignée et progressiste des contenus.

Et ça ne changera pas, car si Mark Zuckerberg n’est pas celui qui supprime chacun de nos posts, cette modération lui convient dans les grandes lignes. Mark Zuckerberg n’exerce pas en personne une censure maligne sur chacune de nos publications en se frottant les mains, mais Mark Zuckerberg se contrefout de l’incapacité du réseau (intelligences artificielles et travailleur·ses confondu·es) à endiguer réellement les propos et contenus misogynes, homophobes, fascistes et haineux. Si les IA et les clickworkers font comme iells peuvent, Facebook, à tendance conservatrice depuis ses débuts, s’accommode très bien des résultats et n’a jamais réellement pris le problème à bras-le-corps, se contentant d’excuses périodiques quand vraiment un bad buzz éclate. Le monde étant ce qu’il est actuellement (patriarcal, raciste et fascisant), sans politique réellement volontariste de la part de Facebook, les IA comme les travailleur·ses continueront de détecter bien plus facilement un téton qui traine qu’un propos misogyne. Facebook, c’est une logique réactionnaire dans un fonctionnement général sexiste et capitaliste qui influe travailleur·ses et algorithmes.

Facebook, m’a aussi expliqué Lou, c’est aussi une fabrique à émotions. Facebook n’est pas là pour t’offrir une information de qualité, ni même une information tout court. Facebook a besoin de clics, Facebook a besoin qu’on poste du contenu, car plus il y a de contenu, plus il y a de pages vues, et plus il y a de pages vues, plus il y a de publicités vues. Facebook a besoin de nos réactions, de nos commentaires, de nos posts, pour générer des vues et donc nous montrer des publicités. Le meilleur moteur de nos réactions, ce sont nos émotions. Et les émotions les plus rentables en réactions, ce sont la colère, l’indignation, les émotions “négatives”. Facebook a tout intérêt à conserver des contenus générant des émotions négatives, car cela produit des interactions et du contenu supplémentaire (commentaires, réactions, partages…), et c’est ce que veut Facebook.

Les émotions sont au cœur des recherches de Facebook : comment les générer, les exploiter, les propager. En 2014, une enième controverse révélait que Facebook avait mené des expérimentations sur la propagation des émotions sur 700.000 utilisatrice·teurs (voir ici ou ici), et ça n’est pas près de s’arranger puisqu’en 2017 Facebook a déposé plusieurs brevets permettant d’analyser les émotions des utilisatrice·teurs à partir de leur image ou des textes qu’iells écrivent.

Lorsqu’on commente rageusement et massivement des propos masculinistes sur une page : on travaille à plein régime pour Facebook, qui se frotte les mains, enfin les pouces bleus. Les émotions, enfin et surtout, et pour le dire simplement rendent plus sensible et réceptif.ve à la publicité. Les émotions captent notre attention et sont un excellent vecteur de l‘efficacité publicitaire, au point de constituer un champ de recherche, une discipline : le neuromarketing. Nous sommes ému·es, secoué·es, enthousiastes, énervé·es : notre “engagement” en tant qu’utilisatrice·teurs du réseau est maximal, les clics sur les publicités augmentent, et Facebook se frotte les pouces, encore.

Un autre paramètre qui peut aussi expliquer en partie les choix de Facebook, c’est que tout géant qu’il est, le réseau social est complètement en perte de vitesse.

Son public vieillit sans se renouveler : les (très) jeunes, les mineur·es, les adolescent·es, ne sont pas sur Facebook, ni sur Instagram d’ailleurs, leur préférant massivement SnapChat. Comment faire revenir les mineur·es sur sa plateforme ? Comment se vendre en tant que réseau social adapté à ce public ? La première réponse tombe sous le sens : en nettoyant tout ce qui peut ressembler de près ou de loin à du porno, en bannissant tout contenu que des parents réac lambda pourraient préférer que leur enfant ne voit pas : image porno, vidéo d’éducation sexuelle, statue d’éphèbe nu ou mot “lesbienne” : tout est mis dans le même sac, il s’agit de rendre Facebook safe pour les très jeunes.

Saluons en tous cas le jeu d’équilibriste, Facebook marche constamment sur une corde raide : il lui s’agit de conserver suffisamment de contenu à fort potentiel d’indignation, de contenter les attentes réactionnaires de ce qui devrait être accessible ou non aux mineur·es, ou encore de ne pas trop contrarier la dominante misogyne sans doute bien plus rentable que le féminisme. Bravo Mark, beau travail 👍 😍

Si ces censures sont abusives et discriminatoires en regard de la bienveillance vis-à-vis des propos réellement haineux, qu’ils soient misogynes, grossophobes, racistes, ou relevant de n’importe quelle autre haine réelle visant un groupe réellement discriminé (par opposition donc, aux hommes, aux blancs ou aux personnes cisgenres par exemple), elles posent aussi un certain nombre de questions concernant le travail fourni par ses utilisatrice·teurs. Parce que oui, nous travaillons, constamment, pour Facebook et Instagram, et gratuitement.

Instagram et Facebook se présentent comme des services de diffusion, ce qui cache la réalité: leur contenu est entièrement produit par ses utilisatrice·teurs, qui travaillent ainsi gratuitement pour ces plateformes. Je parle de travail gratuit, au double sens développé par les analyses féministes : travail non rémunéré, mais également travail invisibilisé comme travail. Rappelons d’ailleurs que les conditions d’utilisation de Instagram permettent à l’application l’exploitation commerciale des photos. Nous fournissons gratuitement tout son contenu artistique à Instagram, qui en dispose à sa guise, et peut tout autant les exploiter que les supprimer.

Cette libre disposition de nos contenus est d’autant plus gênante que Instagram et Facebook se sont rendus quasi indispensables à la diffusion du travail des artistes. Nous ne les utilisons pas réellement par choix, il est très difficile et coûteux en terme de temps et d’argent de se diffuser par d’autres biais à hauteur de ce que permettent ces deux plateformes, en particulier Instagram. Ces applications possèdent le monopole de la diffusion artistique en ligne, il est donc problématique qu’elles puissent exercer de tels abus de pouvoir et exclure de leurs “services” certain·es artistes qui n’entrent pas dans leurs politiques, sans recours, indemnisation ni préavis.

Lorsqu’une publication est censurée, une page fermée, un compte suspendu ou supprimé, il n’y a aucun recours possible. On peut certes exprimer son mécontentement et tenter de contester, donner une mauvaise note à “l’expérience”, mais ces sites ne proposent aucune interaction directe avec les modérateurs, et ne s’embarrassent pas d’une hotline. Il y a très peu de chances d’obtenir une réponse ou un retour quelconque – à moins de réussir à créer le buzz sur une censure très manifestement abusive, auquel cas Facebook ou Instagram se révèlera sans doute plus enclin à présenter des excuses – reconnaissant donc surtout avoir fait erreur. Lorsque les cas sont médiatisés, en particulier lorsqu’il s’agit d’art, il arrive donc que la plateforme fasse machine arrière et présente ses excuses. Là encore, on peut souligner le caractère complètement abusif et aléatoire de censures qui excèdent des règles déjà très strictes et appliquées sans aucun discernement, et le désengagement total de Facebook/Instagram pour compenser les préjudices qui découlent de ces excès de censure. Lorsque Facebook supprime des photos de reconstruction mammaire, lorsque Instagram supprime plusieurs jours le compte d’une artiste avant de se raviser suite aux nombreuses sollicitations de la personne concernée et une tribune dans Libé, quel dédommagement, quelle contrepartie proposent ces plateformes ? Aucune, bien sûr.

Enfin, notons que Facebook et Instagram ont une politique encore plus stricte en ce qui concerne la possibilité de “booster” une publication, à savoir payer pour augmenter sa diffusion. C’est une véritable litanie sans fin d’absurdes subtilités à éviter – tournures de phrases, mots, et bien entendu représentations du corps: la nudité “implicite”, les poses “suggestives”, les zooms sur des parties du corps qu’elles qu’elles soient, sont bannies. En théorie, la photographie d’une statue nue est acceptable; dans la pratique, Facebook censurait en 2018 la publication “boostée” d’une statuette datant du paléolithique ou encore une publication “boostée” reprenant la Liberté guidant le Peuple de Delacroix.

À titre personnel, depuis plus d’un an la publicité de mes dessins est systématiquement rejetée sur les deux plateformes, quels qu’en soient le contenu et le propos. Je travaille sur des thématiques queer et féministes: corps, sexualités, mais aussi harcèlement, religion, enfance. Mes comptes Facebook et Instagram ne sont pas bannis pour le moment, mais la tonalité “explicite” de certains dessins déteint manifestement sur l’ensemble de mon travail et j’ai abandonné tout tentative de “booster” mes dessins y compris les plus “conformes aux “standards”

Et Tumblr ?!

Je concluerai par le coup de massue qu’a été pour de nombreux·ses utilisatrice·teurs l’annonce par Tumblr, le 3 décembre 2018, du bannissement du “contenu adulte” sur la plateforme. Jusqu’à cette annonce fatidique, le réseau social était considéré comme à part car justement il offrait la totale liberté de représentation qu’empêchent depuis leurs débuts Facebook et Instagram. Jusqu’à fin 2018, de fait donc, son contenu était en grande partie pornographique et sexuel, et le lieu de représentation et d’expression de nombreuses communautés et cultures sexuelles : bdsm, shibari, porno gay et queer, porno féministe, body-positive… Il permettait une alternative à l’industrie multimilliardaire de la pornographie hétérosexuelle – conçue pour un regard majoritairement hétérosexuel masculin blanc – et un espace de mise en scène de soi et d’échanges pour de nombreuses personnes en dehors des représentations dominantes.

Le coup d’arrêt récent et le bannissement complet de tout contenu pornographique sur la plateforme semblent contre-intuitifs d’un point de vue commercial. Spontanément et comme à beaucoup d’utilisateur·trices, ce choix m’a semblé complètement suicidaire économiquement pour la plateforme. Mais en réalité, “seulement” 22% des utilisateur·trices de Tumblr venait y chercher de la pornographie, et “seulement” 11% des comptes les plus populaires concernaient la pornographie. Si là encore, l’entrée en vigueur de la loi FOSTA/SESTA peut avoir contribué à cette décision, c’est une erreur de penser que le site a tout à perdre à bannir le porn et que c’est contraint et forcé qu’il prend cette décision. Pour peu qu’en interne, les décideurs et dirigeants changent (le fondateur David Karp est parti en novembre 2017) et/ou se laissent contaminer par le conservatisme de Facebook ou d’Apple, le site peut avoir atteint un équilibre financier qui lui permette de décider de se passer des contenus sexuels.

Apple, historiquement anti-porno, bannissait temporairement l’application Tumblr en décembre dernier (quelques jours donc avant l’annonce de Tumblr) de l’AppStore (son magasin d’application), et l’Indonésie a bloqué Tumblr depuis mars 2018 à cause des contenus adultes: ces bannissements peuvent avoir joué. Le site peut également, à l’instar de Facebook, tenter de rediriger le marché des très jeunes et des mineur·es vers lui, et commencer donc cette opération par un nettoyage radical de son contenu et de son image. Bref, il est certain que le site n’accueillait pas la pornographie – alternative ou non – par altruisme et que s’il y a trouvé son intérêt pendant un temps, ce revirement peut s’expliquer par des considérations à la fois réactionnaires et économiquement justifiées. Au détriment complet des communautés et personnes subalternes, marginalisées, discriminées, exotisées, qui se trouvent privées des possibilités d’accéder à des représentations érotiques alternatives et pensées pour d’autres regards que le regard hétéromasculin (en lire plus ici)

Je remercie Lou de la Quadrature du Net pour ses éclaircissements et sa contribution <3